Další případ zneužití umělé inteligence. Muži s pomocí ChatGPT falšovali důkazy

- Právníci v USA použili ke své práci umělou inteligenci

- ChatGPT si však většinu tvrzení vymyslel

- Nyní od soudu dostali vysokou pokutu

Objevil se další případ neopatrného používání umělé inteligence. Soudce udělil dvěma právníkům z USA pokutu za zneužití AI při obhajobě klienta. Dvojice si nezkontrolovala pravdivost věcí, které jim ChatGPT vygeneroval, a následně je použila jako podklady. Jak to s případem v současné chvíli vypadá?

ChatGPT může i lhát

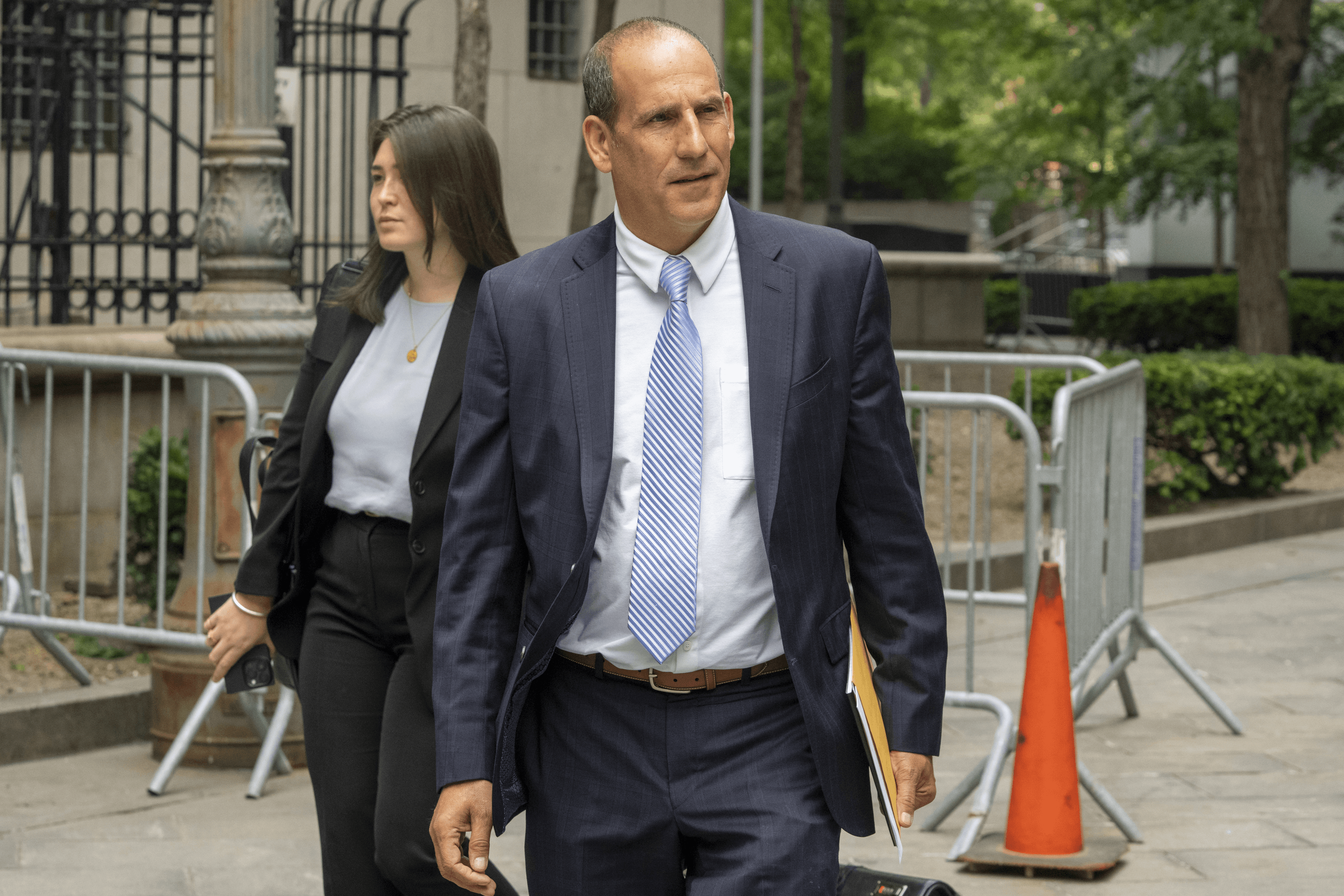

Jak uvádí agentura Reuters, právníci Steven Schwartz a Peter LoDuca musí zaplatit částku ve výši 5 tisíc amerických dolarů (přes 100 tisíc korun). Důvodem má být skutečnost, že soudu zaslali dopis, ve kterém se objevilo 6 smyšlených citací, údajně vytvořených pomocí ChatGPT. Dopis měl sloužit jako materiál při projednávání jejich případu.

K pokutě se oba dva muži odmítli jakkoli vyjádřit, pouze se proti rozhodnutí soudu odvolali. Jediné oficiální prohlášení uvedla firma Levidow, Levidow & Oberman, pro kterou pracují. Stojí v něm: „Udělali jsme chybu v dobré víře, že jsme nevěřili, že by si nějaká technologie mohla vymýšlet případy.“ To se v souvislosti s AI, která je vymýšlením si věcí proslulá, může zdát jako nešťastná výmluva.

Čtěte také: Umělá inteligence nás jednou zničí! Lidé se proti AI bouří, podepisují petice

Neexistující důkazy

Právníci byli odhaleni ve chvíli, kdy se společnost Avianca, s níž vedli spor, obrátila na soud s tím, že nemůže dohledat některá tvrzení, která Schwartz a LoDuca uvádějí.

Schwartz se posléze přiznal, že nedopatřením použil nepravdivé informace vygenerované AI, nicméně při obhajobě na nich stále zakládal své argumenty. Soud se k celé události vyjádřil se slovy, že používání umělé inteligence při práci není nijak zvlášť trestuhodné, dokud nepřekročí hranice etického chování jako tomu bylo v tomto případě.

Příběh těchto dvou právníků je tak jasnou varovnou ukázkou toho, kdy člověk příliš důvěřuje umělé inteligenci a nedomýšlí důsledky takových činů.